International Essays |

E se tivéssemos cérebros maiores? Imaginando mentes além da nossa

E se tivéssemos cérebros maiores? Imaginando mentes além da nossa

21 de maio de 2025

Gatos não falam

Gatos não falam

Nós, humanos, temos cerca de 100 bilhões de neurônios em nossos cérebros. Mas e se tivéssemos muito mais? Ou se as inteligências artificiais que construímos efetivamente tivessem muito mais? Que tipos de coisas poderiam então se tornar possíveis? Com 100 bilhões de neurônios, sabemos, por exemplo, que a linguagem composicional — como a que usamos — é possível. Com cerca de 100 milhões de neurônios, como um gato, aparentemente não é. Mas o que se tornaria possível com 100 trilhões de neurônios? E seria algo que sequer conseguiríamos compreender?

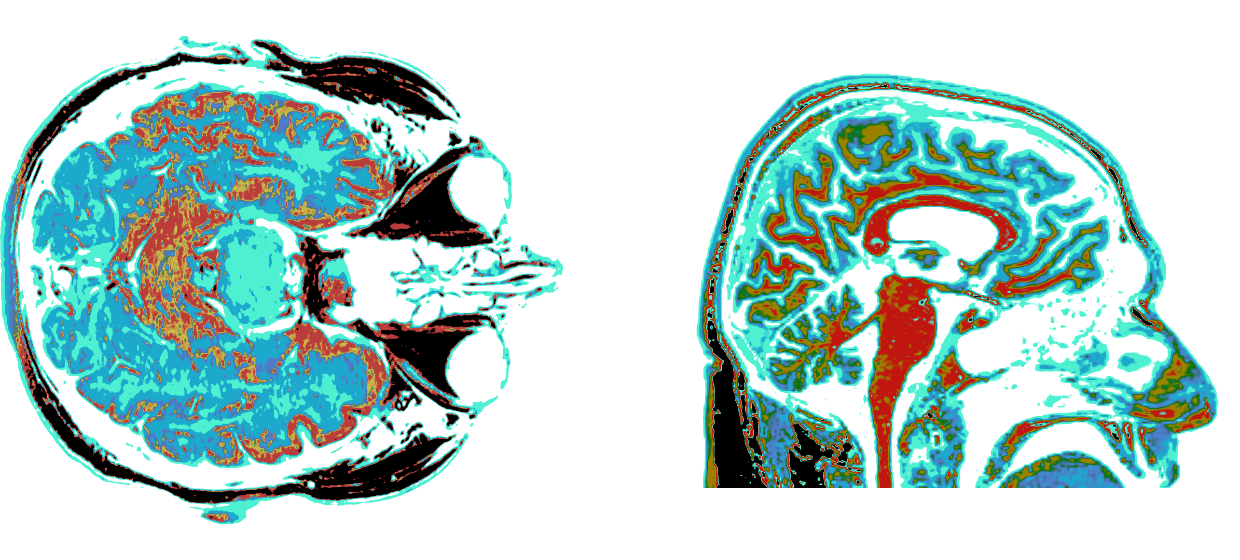

Meu objetivo aqui é começar a explorar essas questões, com base no que vimos nos últimos anos em redes neurais e LLMs, bem como no que agora sabemos sobre a natureza fundamental da computação, sobre neurociência e sobre o funcionamento de cérebros reais (como o que está escrevendo isto, representado aqui):

Um ponto sugestivo é que, à medida que as redes neurais artificiais crescem, elas parecem ultrapassar sucessivos limiares de capacidade:

In[]:=

Text[Grid[{Row[{"~",Superscript[10,#1]," connections"}],#2}&@@@{{5,"recognize images of 10 digits"},{6,"recognize images of all letters"},{7,"recognize images of 5000 picturable nouns "},{8,"transcribe speech from audio"},{9,"generate photorealistic images from text"},{11,"generate fluent natural language text"}},Alignment->Left,Frame->All,FrameStyle->GrayLevel[.7]]]

~ 5 10 | recognize images of 10 digits |

~ 6 10 | recognize images of all letters |

~ 7 10 | recognize images of 5000 picturable nouns |

~ 8 10 | transcribe speech from audio |

~ 9 10 | generate photorealistic images from text |

~ 11 10 | generate fluent natural language text |

Então, o que vem a seguir? Sem dúvida haverá coisas como controle robótico humanóide, que têm analogias diretas com o que nós, humanos, já fazemos. Mas e se formos muito além das ~10¹⁴ conexões que nossos cérebros possuem? Que novos tipos qualitativos de capacidade poderiam surgir?

Se estivéssemos falando apenas de “computação em geral”, não haveria muito o que discutir. O Princípio da Equivalência Computacional implica que, além de certo limite inferior, sistemas computacionais podem genericamente produzir comportamentos que correspondem à computação tão sofisticada quanto é possível. E, de fato, é o que observamos em muitos contextos abstratos e também no mundo natural.

Mas o ponto aqui é que não estamos lidando com “computação em geral”. Estamos lidando com os tipos de computação que os cérebros realizam fundamentalmente. E a essência disso parece estar em processar grandes quantidades de dados sensoriais e, em seguida, tomar decisões sobre o que fazer a seguir.

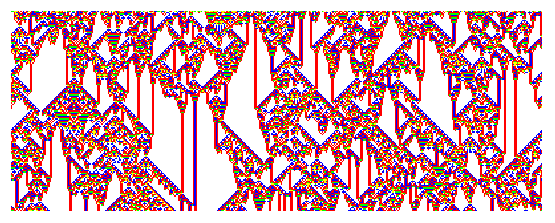

Não é óbvio que exista uma maneira razoável de fazer isso. O mundo é repleto de irredutibilidade computacional — em que a única forma geral de descobrir o que acontecerá em um sistema é simplesmente executar suas regras passo a passo e ver o resultado:

E sim, há muitas questões e situações em que não há alternativa a não ser fazer essa irredutibilidade computacional — assim como há muitos casos em que os LLMs precisam recorrer ao nosso sistema de computação em Wolfram Language para efetuar cálculos. Mas os cérebros, nas tarefas mais cruciais para eles, parecem conseguir “avançar” sem simular cada detalhe. E o que torna isso possível é o fato fundamental de que, dentro de qualquer sistema que exiba irredutibilidade computacional geral, deve haver inevitavelmente um número infinito de “bolsões de redutibilidade computacional”, associados a “padrões simplificadores” do comportamento do sistema.

São esses “bolsões de redutibilidade” que os cérebros exploram para conseguir “navegar” com sucesso no mundo, apesar de seu pano de fundo de irredutibilidade computacional. E, nesse sentido, o progresso da ciência (e da tecnologia) pode ser entendido como a identificação de um número crescente desses bolsões de redutibilidade. Podemos imaginar, então, que as capacidades de cérebros maiores girariam em torno da habilidade de “reter” mais desses bolsões de redutibilidade computacional na mente.

Podemos pensar nos cérebros como servindo fundamentalmente para “comprimir” a complexidade do mundo, extraindo dele apenas certas características — associadas a bolsões de redutibilidade — que nos interessam. E, para nós, uma manifestação-chave disso é a ideia de conceitos e de linguagem que os utiliza. No nível do input sensorial bruto, podemos ver muitas imagens detalhadas de uma categoria de coisas — mas a linguagem nos permite descrevê-las todas com um único conceito simbólico (por exemplo, “pedra”).

Numa primeira aproximação, podemos imaginar uma correspondência direta entre conceitos e palavras em nossa linguagem. E é notável que todas as línguas humanas tendam a ter cerca de 30 mil palavras (ou construções semelhantes a palavras) de uso comum. Então, será que essa escala é resultado do tamanho dos nossos cérebros? E será que cérebros maiores poderiam lidar com muito mais palavras — milhões, talvez?

“Mas sobre o que todas essas palavras poderiam tratar?”, podemos perguntar. Afinal, nossa experiência cotidiana nos faz pensar que nossas atuais 30 mil palavras são suficientes para descrever o mundo como ele é. Mas, de certo modo, isso é circular: inventamos as palavras que temos porque são as que precisamos para descrever os aspectos do mundo que nos importam. Sempre haverá mais características do mundo natural sobre as quais poderíamos falar — apenas não escolhemos nos envolver com elas. (Por exemplo, poderíamos inventar palavras para todos os padrões detalhados das nuvens no céu, mas esses padrões não são algo sobre o qual sentimos necessidade de conversar em detalhe.)

Dado nosso conjunto atual de palavras ou conceitos, será que ele é “fechado”? Podemos operar de forma consistente dentro de um “recorte do espaço conceitual” ou sempre precisaremos de novos conceitos? Podemos pensar em novos conceitos como associados ao progresso intelectual — algo que escolhemos buscar ou não. Mas, na medida em que o “funcionamento do mundo” é computacionalmente irredutível, é basicamente inevitável que eventualmente nos deparemos com coisas que não podem ser descritas por nossos conceitos atuais.

Então, por que o número de conceitos (ou palavras) não aumenta constantemente? Uma razão fundamental é a abstração. A abstração permite agrupar um grande número de coisas específicas (“tigre”, “leão”, etc.) e descrevê-las de forma mais “abstrata” e geral (digamos, “grandes felinos”). E a abstração é útil quando é possível fazer afirmações coletivas sobre essas categorias gerais (“todos os grandes felinos têm…”), oferecendo uma forma consistente e de nível mais alto de pensar sobre o mundo.

Se imaginarmos os conceitos como associados a bolsões específicos de redutibilidade, o fenômeno da abstração reflete a existência de redes entre esses bolsões. E, sim, tais redes também podem exibir irredutibilidade computacional, que por sua vez pode conter seus próprios bolsões de redutibilidade, e assim por diante.

Como os Cérebros Parecem Funcionar

Como os Cérebros Parecem Funcionar

Linguagem e Além

Linguagem e Além

Sensores e Autuadores

Sensores e Autuadores

Abstração

Abstração

Linguagem Computacional

Linguagem Computacional

Muitos cérebros juntos: A formação da sociedade

Muitos cérebros juntos: A formação da sociedade

Mentes além da nossa

Mentes além da nossa